Il y a 48 jours

Roblox et son contrôle d’âge : entre IA défaillante et fraudes, les joueurs en colère !

h2

Roblox impose une vérification faciale par IA pour sécuriser son chat, mais le système, critiqué pour ses erreurs et ses failles, divise les joueurs. Entre contournements créatifs, bourdes algorithmiques et inquiétudes sur la protection des données, seulement 51 % des utilisateurs se soumettent au contrôle. Un débat explosif entre sécurité et vie privée.

A retenir :

- Vérification faciale obligatoire : Roblox utilise une IA pour estimer l’âge des joueurs et autoriser l’accès au chat, mais le système, déployé en Australie, Nouvelle-Zélande et Pays-Bas, accumule les ratés.

- Contournements en série : des comptes "9 ans" vendus sur eBay, des tutoriels pour tromper l’IA avec des photos de célébrités ou des maquillages vieillissants, et des parents classés "21+" après validation.

- Erreurs algorithmiques : des adultes identifiés comme adolescents, des préados catégorisés comme majeurs… L’IA de Persona, partenaire controversé, multiplie les approximations.

- Rejet massif : 40 % des joueurs préfèrent abandonner le chat plutôt que de partager leurs données biométriques, et seulement 51 % des utilisateurs actifs ont complété la vérification.

- Protestations et poursuites : des mouvements in-game refusent ce système perçu comme intrusif, tandis que Persona est visé par des plaintes pour gestion douteuse des données.

- Dilemme éthique : Roblox doit-il sacrifier la vie privée au nom de la sécurité, ou repenser son approche pour regagner la confiance des joueurs ?

Un système censé protéger, mais qui dérape dès le lancement

Depuis décembre 2023, Roblox impose une vérification faciale par IA pour accéder au chat en jeu, une mesure présentée comme une avancée majeure pour protéger les jeunes joueurs des risques en ligne. Le principe ? Une intelligence artificielle analyse les traits du visage via une photo ou une vidéo en temps réel, puis attribue une tranche d’âge (13-, 13-17, ou 18+). Problème : dès ses premiers jours en Australie, Nouvelle-Zélande et Pays-Bas, le système a révélé des failles béantes, transformant une initiative sécuritaire en un cas d’école des dérives technologiques.

Les joueurs n’ont pas tardé à exploiter ses faiblesses. Sur eBay, des comptes vérifiés comme appartenant à des enfants de 9 ans se négocient à prix d’or, tandis que des tutoriels fleurissent sur TikTok et YouTube pour duper l’IA : utilisation d’avatars virtuels générés par des outils comme DALL·E, photos de célébrités (un visage jeune comme Timothée Chalamet pour passer en 13-, ou un Dwayne Johnson pour obtenir le sésame 18+), voire des maquillages improvisés simulant rides ou barbes. Certains parents, en validant l’âge de leurs enfants, se sont même retrouvés classés dans la catégorie 21+ par erreur. Un comble pour un système censé distinguer un adulte d’un mineur.

Mais le pire vient de l’IA elle-même. Des utilisateurs majeurs se voient attribués un âge adolescent, tandis que des préadolescents sont catégorisés comme adultes. Schlep, un créateur de contenu spécialisé dans la sécurité sur Roblox, a testé le système avec des jumeaux de 12 et 17 ans : le premier a été identifié comme un adulte, le second comme un enfant. "C’est comme si l’IA jouait à pile ou face avec notre vie privée"*, ironise-t-il dans une vidéo vue plus de 2 millions de fois. Une fiabilité remise en question, d’autant que 40 % des joueurs préfèrent renoncer au chat plutôt que de soumettre leurs données à Persona, le prestataire sous contrat avec Roblox.

"Big Brother" ou protecteur ? La communauté se rebelle

Derrière ces dysfonctionnements se cache un débat bien plus large : celui de l’équilibre entre sécurité et vie privée. Selon les données internes de Roblox, seulement 51 % des utilisateurs actifs quotidiens ont complété la vérification dans les régions tests, un taux révélateur d’une adoption mitigée. Pourtant, la plateforme justifie cette mesure par la nécessité de lutter contre le harcèlement, les discours haineux et les prédateurs en ligne. "Nous voulons créer un environnement sûr pour tous, surtout pour les plus jeunes"*, déclare un porte-parole de Roblox. Mais à quel prix ?

Car Persona, l’entreprise derrière cette technologie, est loin de faire l’unanimité. Actuellement visée par des poursuites judiciaires aux États-Unis pour collecte et gestion contestées des données biométriques, elle accumule les critiques. L’Electronic Frontier Foundation (EFF), une ONG spécialisée dans les droits numériques, met en garde : "Confier ses données faciales à une IA opaque, c’est comme signer un chèque en blanc pour des usages futurs inconnus."* Une inquiétude partagée par des milliers de joueurs, qui organisent des mouvements de protestation in-game. Sur des serveurs dédiés, des avatars brandissent des pancartes avec des slogans comme "No Face Scan, No Chat"* ou "Roblox, arrête de jouer avec nos données !"*.

Certains créateurs de contenu, comme KonekoKitten (1,8 million d’abonnés sur YouTube), ont même lancé des pétitions pour exiger un système alternatif, comme une vérification par pièce d’identité ou un contrôle parental renforcé. "Pourquoi devrions-nous accepter un outil qui nous prend pour des cobayes ?"*, s’interroge-t-elle dans une vidéo virale. Une question qui résonne particulièrement chez les adolescents, souvent les plus exposés aux risques en ligne… mais aussi les plus réticents à partager leurs données biométriques.

Derrière l’IA : un partenariat qui fait polémique

Pour comprendre les ratés de ce système, il faut remonter à son origine : le partenariat entre Roblox et Persona, une startup spécialisée dans la vérification d’identité. Fondée en 2018, cette entreprise promet une "vérification d’âge sans friction"*, mais son historique est loin d’être irréprochable. En 2022, une fuite de données a exposé les informations personnelles de milliers d’utilisateurs, et des lanceurs d’alerte ont accusé l’entreprise de revendre des données à des tiers sans consentement explicite.

Pourtant, Roblox a choisi de lui confier une mission sensible : analyser les visages de millions de joueurs, dont une majorité de mineurs. "C’est comme si on donnait les clés de notre maison à un inconnu"*, compare Marcus, un développeur de jeux sur Roblox interrogé par nos soins. D’autant que le système actuel ne se contente pas d’une simple photo : pour les cas litigieux, il peut exiger une vidéo en temps réel, où l’utilisateur doit tourner la tête ou cligner des yeux pour prouver qu’il s’agit bien d’une personne réelle. Une procédure qui rappelle les contrôles douaniers… mais sans garantie de transparence.

Face aux critiques, Roblox a tenté de rassurer en affirmant que les données étaient "chiffrées et supprimées après vérification"*. Pourtant, des experts en cybersécurité, comme Bruce Schneier, soulignent que "une fois une donnée biométrique collectée, elle peut être copiée, piratée ou détournée. Contrairement à un mot de passe, on ne peut pas la changer."* Un risque que beaucoup de joueurs ne sont pas prêts à prendre, surtout quand le système semble aussi peu fiable.

Et si la solution venait… des joueurs ?

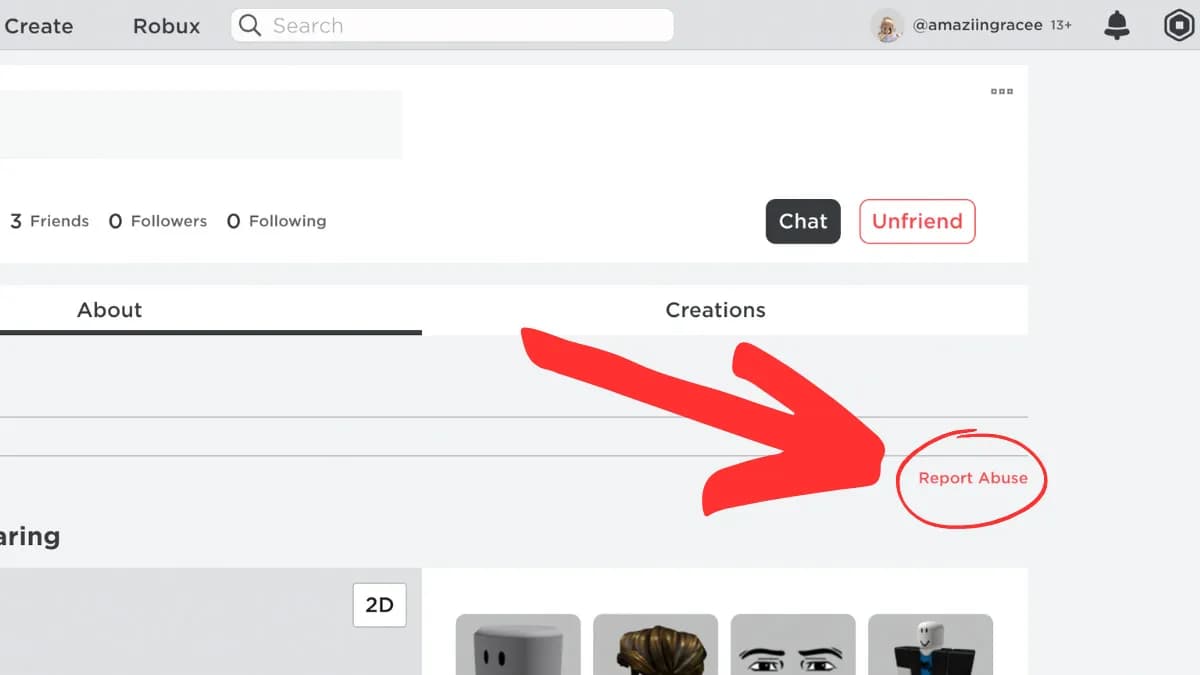

Paradoxalement, c’est peut-être la communauté elle-même qui offre des pistes pour améliorer le système. Certains serveurs Roblox ont mis en place des modérations communautaires, où des joueurs bénévoles signalent les comportements suspects. D’autres proposent des systèmes de parrainage : un joueur vérifié peut "parrainer" un nouveau venu après l’avoir connu en jeu, évitant ainsi la vérification faciale.

Le studio Wonder Works, derrière des jeux comme Adopt Me!, a même développé un chat filtré par IA qui analyse les messages en temps réel pour bloquer les contenus inappropriés, sans nécessiter de vérification d’âge. "Pourquoi forcer les joueurs à partager leur visage quand on peut filtrer les mots ?"*, questionne Newfissy, son fondateur. Une approche qui séduit de plus en plus de développeurs, lassés des polémiques autour de Persona.

Roblox se trouve donc à la croisée des chemins. D’un côté, la pression des régulateurs (comme la COPPA aux États-Unis ou le RGPD en Europe) exige des mesures strictes pour protéger les mineurs. De l’autre, une communauté de plus en plus méfiante envers les technologies intrusives. "Ils veulent nous protéger, mais ils nous espionnent. Où est la limite ?"*, résume Luna, une joueuse de 16 ans. Une question à laquelle Roblox devra répondre rapidement, sous peine de voir ses utilisateurs désertifier vers des plateformes moins contraignantes.