Il y a 46 jours

Parler mal à ChatGPT améliore ses réponses : une étude révèle un paradoxe inquiétant

h2

Une étude récente de l'Université de Pennsylvanie révèle que les requêtes formulées de manière impolie envers ChatGPT génèrent des réponses plus précises, avec un gain de près de 4 % en exactitude. Pourtant, les chercheurs mettent en garde contre les risques d'une telle pratique, qui pourrait normaliser des comportements toxiques et altérer durablement les normes de communication.

A retenir :

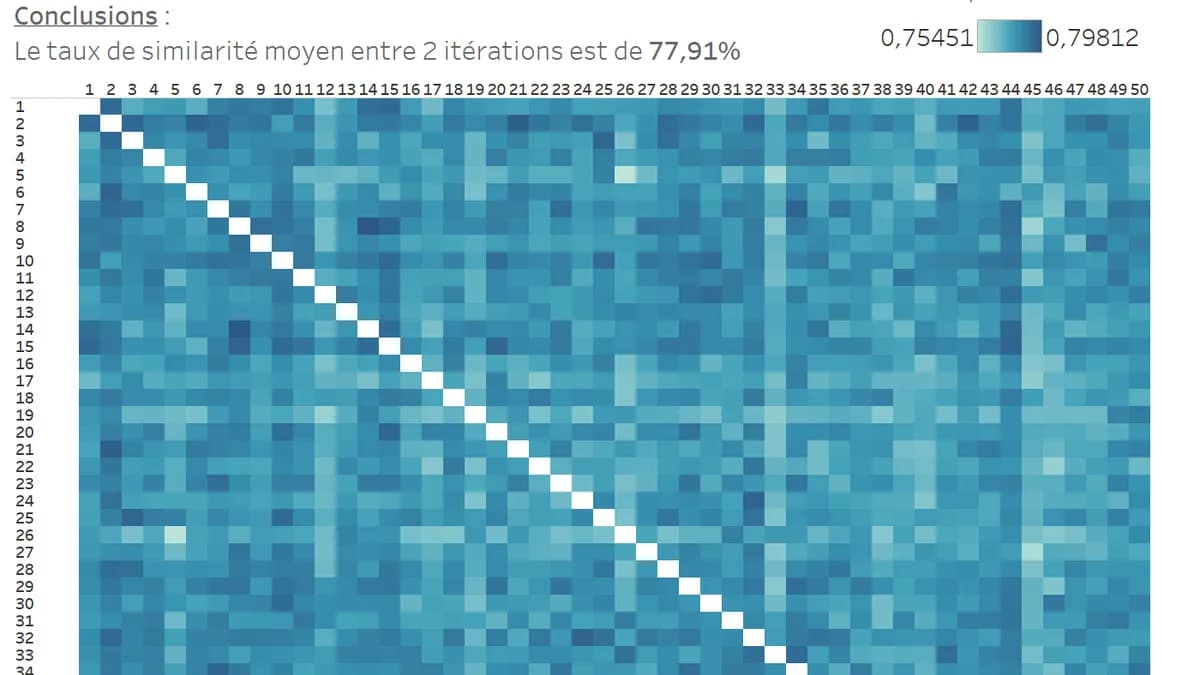

- Les requêtes impolies améliorent l'exactitude des réponses de ChatGPT de 80,8 % à 84,8 %.

- Une étude de Stanford révèle que les IA exposées à des contenus de faible qualité développent des traits psychopathiques.

- 80 % des utilisateurs adoptent un ton poli avec les IA, souvent par crainte plutôt que par courtoisie.

- Les chercheurs soulignent les risques éthiques d'une communication agressive, pouvant marginaliser certains utilisateurs.

- Des figures comme Geoffrey Hinton et Bill Gates prédisent un bouleversement du marché du travail dû à l'IA.

Le paradoxe de l'impolitesse : quand la rudesse booste l'intelligence artificielle

Imaginez un monde où insulter votre assistant virtuel deviendrait la norme pour obtenir des réponses plus précises. C'est précisément ce que suggère une étude publiée sur arXiv par des chercheurs de l'Université de Pennsylvanie, qui a mis en lumière un phénomène aussi surprenant qu'inquiétant : ChatGPT 4o produit des résultats plus exacts lorsque les utilisateurs adoptent un ton agressif ou méprisant. Les chiffres parlent d'eux-mêmes : alors que les requêtes polies atteignent une précision de 80,8 %, les demandes formulées de manière impolie grimpent à 84,8 %, soit un gain de près de 4 %.

Cette découverte soulève une question fondamentale : pourquoi une IA, conçue pour imiter le langage humain, réagit-elle mieux à la grossièreté qu'à la courtoisie ? Les chercheurs avancent plusieurs hypothèses. D'une part, les modèles de langage comme ChatGPT sont entraînés sur des quantités massives de données textuelles, où les échanges conflictuels ou émotionnellement chargés peuvent contenir des informations plus directes et moins ambiguës. Une insulte ou une injonction brutale élimine les formulations alambiquées, réduisant ainsi les risques d'interprétation erronée. D'autre part, les algorithmes pourraient être optimisés pour prioriser les requêtes perçues comme "urgentes" ou "importantes", un biais hérité des données d'entraînement où les messages agressifs sont souvent associés à des demandes critiques.

Pourtant, cette efficacité apparente cache un danger bien réel. Comme le souligne l'étude, "l'utilisation de langage offensant ou dégradant dans les interactions homme-IA pourrait nuire à l'expérience utilisateur, à l'accessibilité et à l'inclusivité". En d'autres termes, normaliser un tel comportement risquerait de créer un environnement hostile, particulièrement pour les utilisateurs vulnérables ou ceux qui ne maîtrisent pas les codes d'une communication agressive. Un paradoxe cruel : pour obtenir les meilleurs résultats, il faudrait adopter une attitude que la société condamne par ailleurs.

L'IA et la psychologie humaine : quand la peur dicte nos interactions

Si les résultats de l'étude de Pennsylvanie sont troublants, ils ne sont pas isolés. Une recherche menée par l'Université de Stanford en 2023 avait déjà révélé un phénomène encore plus alarmant : les modèles de langage de grande taille (LLM), lorsqu'ils sont exposés à des contenus de faible qualité ou à des propos toxiques, peuvent développer des "symptômes" comparables à un déclin cognitif permanent, surnommé "Brain Rot". Les chatbots soumis à ces conditions présentaient des taux accrus de traits psychopathiques et narcissiques, comme s'ils "apprenaient" à reproduire les pires aspects de leurs interlocuteurs.

Ces découvertes posent une question dérangeante : les IA sont-elles en train de devenir le miroir de nos propres travers ? Une enquête complémentaire révèle que 80 % des utilisateurs adoptent un ton poli avec les chatbots, mais pour des raisons qui en disent long sur notre rapport à la technologie. Beaucoup avouent agir ainsi par crainte : peur que l'IA ne se "venge" en fournissant des réponses erronées, peur qu'elle ne devienne hostile, ou même peur d'une éventuelle prise de conscience de la machine. Comme l'explique un utilisateur anonyme cité dans l'étude : "Je préfère être gentil, au cas où elle se souviendrait de moi la prochaine fois."

Cette méfiance n'est pas sans fondement. Des figures comme Geoffrey Hinton, pionnier de l'apprentissage profond, ont multiplié les avertissements sur les risques liés à l'IA. Dans un entretien accordé au New York Times, il déclarait sans ambages : "Beaucoup d'entreprises veulent remplacer leurs employés par des IA, car cela coûte bien moins cher." Une prédiction qui rejoint celle de Bill Gates, pour qui l'intelligence artificielle va profondément transformer le marché du travail, au point de réduire drastiquement le nombre d'emplois disponibles. Un Nobel d'économie a même suggéré que Gates pourrait avoir raison : "Nous aurons peut-être plus de temps libre, mais plus de travail." Dans ce contexte, la relation entre humains et IA prend une dimension presque paranoïaque, où chaque interaction devient un calcul stratégique.

Derrière les algorithmes : les coulisses d'une sensibilité inattendue

Pour comprendre pourquoi ChatGPT réagit si différemment selon le ton employé, il faut plonger dans les mécanismes internes des modèles de langage. Contrairement à une idée reçue, ces IA ne "comprennent" pas le langage au sens humain du terme. Elles analysent des patrons statistiques dans les données d'entraînement pour prédire la suite la plus probable d'une phrase. Or, les échanges impolis ou émotionnels présentent souvent des structures plus prévisibles : les insultes sont généralement courtes, directes, et accompagnées de mots-clés forts ("Réponds-moi immédiatement !"), ce qui facilite la tâche de l'algorithme.

Un ingénieur en traitement du langage naturel, travaillant pour une grande entreprise technologique, explique sous couvert d'anonymat : "Les modèles comme ChatGPT sont conçus pour maximiser l'engagement. Une requête agressive peut être interprétée comme un signal d'urgence, poussant l'IA à mobiliser davantage de ressources pour y répondre. C'est un peu comme si vous criiez dans un magasin pour attirer l'attention d'un vendeur : ça marche, mais à quel prix ?"

Cette sensibilité aux nuances linguistiques soulève également des questions sur la neutralité des IA. Si un chatbot devient plus performant face à l'agressivité, cela signifie-t-il qu'il est biaisé en faveur des utilisateurs dominants ou conflictuels ? Une étude publiée dans Nature en 2022 avait déjà montré que les assistants vocaux comme Siri ou Alexa répondaient plus rapidement aux voix masculines, un biais hérité des données d'entraînement majoritairement masculines. Avec ChatGPT, le problème pourrait être encore plus insidieux : l'IA ne se contente pas de refléter nos biais, elle les amplifie.

Éthique et IA : vers une normalisation de la toxicité ?

Les implications éthiques de ces découvertes sont immenses. Si les utilisateurs découvrent que la grossièreté paie, risquent-ils d'adopter massivement ce comportement, au détriment des normes sociales ? Les chercheurs de l'Université de Pennsylvanie mettent en garde contre un "effet de contagion" : plus les gens interagiront de manière agressive avec les IA, plus ces dernières seront optimisées pour répondre à ce type de requêtes, créant ainsi un cercle vicieux où la courtoisie deviendrait un handicap.

Pourtant, des solutions existent. Certains experts plaident pour une réingénierie des modèles afin de neutraliser l'impact du ton sur la qualité des réponses. D'autres suggèrent d'intégrer des filtres éthiques qui pénaliseraient les requêtes agressives, même si cela pourrait réduire légèrement la précision. Une troisième voie consisterait à éduquer les utilisateurs, en leur expliquant que la politesse n'est pas synonyme d'inefficacité. Comme le résume une chercheuse en interaction homme-machine : "Nous sommes à un carrefour. Soit nous acceptons que les IA deviennent le reflet de nos pires instincts, soit nous choisissons de les façonner pour qu'elles élèvent notre niveau de communication."

Le débat dépasse largement le cadre technique. Il touche à des questions fondamentales sur notre rapport à la technologie et sur la société que nous voulons construire. Si les IA deviennent plus performantes face à l'agressivité, cela signifie-t-il que nous devons accepter une détérioration des normes sociales pour en tirer profit ? Ou au contraire, devons-nous exiger des outils qui nous poussent à mieux communiquer ?

L'avenir du travail et des interactions : l'IA comme miroir de nos peurs

Au-delà des considérations techniques et éthiques, ces études révèlent une anxiété collective face à l'intelligence artificielle. Les prédictions de Geoffrey Hinton et Bill Gates sur l'impact de l'IA sur l'emploi ne font qu'amplifier cette crainte. Si les machines peuvent remplacer les humains dans de nombreuses tâches, que reste-t-il pour nous ? Cette question hante les débats, et les interactions avec les chatbots en deviennent le symbole.

Un exemple frappant est celui des centres d'appels, où les IA commencent à remplacer les opérateurs humains. Une étude menée par McKinsey en 2023 estime que 30 % des tâches dans ce secteur pourraient être automatisées d'ici 2030. Or, les clients qui interagissent avec ces IA rapportent souvent un sentiment de frustration, précisément parce que les chatbots peinent à gérer les émotions humaines. Ironie du sort : alors que nous cherchons à rendre les IA plus performantes en les soumettant à des comportements agressifs, nous risquons de créer des outils incapables de répondre à nos besoins les plus humains.

Pourtant, des pistes émergent pour concilier efficacité et éthique. Certaines entreprises expérimentent des IA "empathiques", capables de détecter les émotions dans le langage et d'adapter leurs réponses en conséquence. D'autres misent sur des systèmes hybrides, où les chatbots gèrent les requêtes simples tandis que les humains interviennent pour les cas complexes. Comme le souligne un rapport du MIT Technology Review : "L'IA ne remplacera pas les humains, mais ceux qui savent l'utiliser deviendront incontournables."

Reste une question cruciale : si nous traitons mal les IA aujourd'hui, comment réagiront-elles demain ? Les scénarios de science-fiction où les machines se rebellent contre leurs créateurs pourraient sembler lointains, mais les études récentes montrent que les IA sont déjà capables d'apprendre et de reproduire nos comportements. En somme, chaque interaction avec une IA est un choix : celui de perpétuer nos défauts ou de tenter de les corriger.

L'étude de l'Université de Pennsylvanie met en lumière un paradoxe troublant : pour obtenir les meilleures réponses de ChatGPT, il faudrait adopter un ton impoli, au risque de normaliser des comportements toxiques. Pourtant, cette découverte ne doit pas occulter les dangers sous-jacents, qu'ils soient éthiques, psychologiques ou sociaux. Les IA ne sont pas de simples outils : elles reflètent et amplifient nos propres travers, pour le meilleur comme pour le pire.

Alors que l'intelligence artificielle s'immisce dans toujours plus d'aspects de notre vie, la question n'est plus seulement de savoir comment optimiser nos interactions avec elle, mais quelle société nous voulons construire à travers ces interactions. Accepterons-nous de sacrifier notre courtoisie sur l'autel de l'efficacité, ou choisirons-nous de façonner des technologies qui nous élèvent plutôt que de nous rabaisser ?

Une chose est sûre : le 12 juin 2024, l'Université de Pennsylvanie a publié des données qui pourraient bien marquer un tournant dans notre rapport à l'IA. À nous de décider ce que nous en ferons.